L'un des phénomènes les plus détestés par les chatbots AI actuels s'appelle les hallucinations. Autrement dit, des réponses apparemment convaincantes qui nous fournissent une IA, mais qui sont en fait totalement fausses. Cela peut être le résultat du manque de contexte, de formation ou que le système préfère combler les lacunes plutôt que d'admettre une incertitude. Mais nous pouvons facilement inverser cette situation.

Tous ceux qui l'écrivent et le planifier. Il ne suffit pas de « demander du bien ». Nous devons également diriger le comportement du modèle afin que notre interaction gagne en précision et en qualité. Même ainsi, d'Openai, ils sont méridiens de cette situation. Et les utilisateurs ne sont pas non plus étrangers à ces erreurs. D'après Chatgpt, nous avons un moyen direct et efficace de minimiser ces types d'erreurs graves.

Plus précisément, nous avons des instructions personnalisées de Chatgpt et une série de règles pour demander l'IA que votre façon de répondre est aussi véridique que possible. Et pour cela, nous ne devons indiquer que quatre règles très simples que nous allons décrire dans cet article. De cette façon, nous cesserons toute possibilité que l'IA conjecture avec les données.

Que sont les hallucinations et pourquoi ils se produisent

Les hallucinations se produisent lorsque le modèle d'IA est responsable du commission des lacunes d'informations au moyen d'informations non vérifiées, au lieu de déclarer qu'elle n'a pas de données suffisantes. Et cela se produit parce que les modèles sont formés pour générer le « meilleur mot » suivant dans une chaîne de texte. Mais ne vous arrêtez pas quand vous ne savez pas. Ceci est documenté par Openai dans son «rapport technique de GPT-4 en 2024.

Les causes que ces actions motivent généralement le manque de contexte, les invites imprécises, les données de formation incomplètes ou contradictoires ou toute tâche qui nécessite des données mises à jour que l'IA n'a pas encore disponibles.

Dans les nouvelles techniques ou en matière de droit, le risque d'hallucinations augmente face à l'énorme quantité de données et de détails qui peuvent posséder un errata. Cependant, nous pouvons atténuer ce type de défaillance d'une IA via un ensemble de règles.

Les 4 règles pour éliminer les hallucinations dans le chatgpt

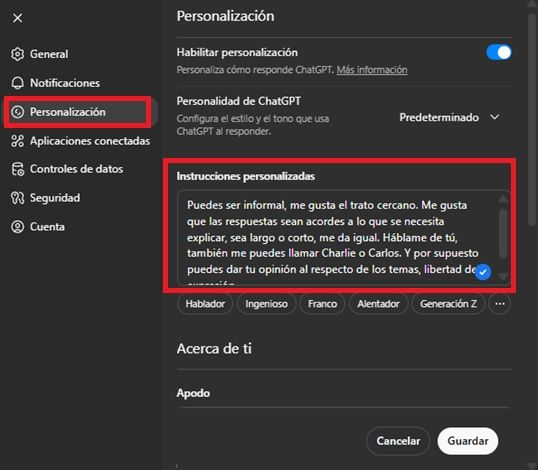

La première chose que nous devons faire est d'aller sur la plate-forme Web Chatgpt et de cliquer sur l'icône de notre profil, où nous devons cliquer sur « Personnalisation ». C'est là que nous voulions y arriver.

Plus précisément, dans la zone de texte que vous verrez avec le nom des « instructions personnalisées » et où nous allons afficher les quatre règles pour les suivre à tout moment. Gardez à l'esprit que vous devez ajouter les lignes suivantes à la boîte coutumière, alors laissez-la aussi claire que vous pouvez à l'avance.

- « Vous êtes un modèle de raisonnement logique. » En définissant le modèle comme un raisonnement logique, il est obligé de hiérarchiser les chaînes d'inférence sur les réponses créatives. Ce qui réduit la possibilité que le remplissage de texte soit généré.

- « Résolvez le problème étape par étape montrant chaque étape. » Qui oblige à exposer tout conflit et à faciliter tout saut illogique de l'IA.

- « Si vous n'avez pas assez d'informations ou si vous n'êtes pas sûr, répondez: je ne peux pas résoudre ce problème avec certitude en raison d'informations insuffisantes. » Ce qui réduit toute conjecture et bouclier la fiabilité.

- «Vérifiez votre réponse avant de le donner; Si vous détectez une hallucination, indiquez-la ». Le dernier filtre pour détecter toute incohérence ou figure lâche.

De manière complémentaire, dans le cas où vous souhaitez travailler dans un ensemble d'informations très spécifiques, vous pouvez ajouter un autre ordre du type « répondre uniquement avec ce qui se trouve dans ces sources », ajoutant les liens correspondants, pour affiner la clarté.

| Plate-forme | Fonction existante | Nom de la fonction | Accès aux utilisateurs | Applicabilité des 4 règles |

|---|---|---|---|---|

| Chatgpt (openai) | Ouais | Instructions personnalisées | Interface directe | Applicable directement |

| Claude (anthropique) | Oui (limité) | Invites du système | Uniquement via API / technique | Nécessite une adaptation technique |

| Gémeaux (Google) | Partiel | Paramètres de configuration | API et configurations limitées | Applicable à la reformulation |